Alors qu’Apple s’apprête à déployer iOS 17 et MacOS Sonoma cet automne, la firme de Cupertino vient de publier des mises à jour pour ses OS mobile et Mac. Elles contiennent de nombreux correctifs de sécurité à appliquer au plus vite.

iOS 16 d’Apple est disponible pour être installé sur les iPhone depuis le 12 septembre 2022, mais alors que plusieurs fonctionnalités sont arrivées il y a près d’un an, le nombre de correctifs ne se tarit pas. Ce 24 juillet, la version iOS 16.6 a été publiée, et contrairement à d’habitude, cette dernière itération ne contient pas de fonctionnalités supplémentaires mais uniquement « des correctifs importants et des améliorations liés à la sécurité » indique Apple dans la page liée, ajoutant qu’elle « est recommandée à tous les utilisateurs ». Pour mémoire, la firme de Cupertino a lancé le processus de test de la version bêta d’iOS 16.6 juste un jour après la sortie d’iOS 16.5 et environ deux semaines avant l’arrivée de la première version bêta pour développeurs d’iOS 17.

Disponible pour tous, cette version de maintenance compte pas moins de 16 correctifs, dont plusieurs problèmes liés au Kernel et au Webkit (moteur de rendu). Pour deux des problèmes de sécurité, Apple indique qu’il sait qu’ils ont peut-être déjà été activement exploités, bien que l’un d’entre eux ait déjà été corrigé dans la version 16.5.1 (c) via Rapid Security Response. Une mise à jour qu’il convient donc d’appliquer sans tarder. La version bêta d’iOS 16.6 contenait également du code pour activer la vérification de la clé des contacts sur iMessage. Cette mesure de sécurité vérifie l’authenticité des utilisateurs d’iMessage et s’adresse à ceux qui ont des exigences de sécurité élevées (comme ceux ciblés par du cyber-espionnage). On ne sait pas encore si cette fonction a été intégrée à la version complète.

MacOS Ventura profite également de correctifs de sécurité

Le système d’exploitation pour Mac profite également d’une mise à jour. Baptisée Ventura 13.5, cette version devrait être la dernière avant l’arrivée de MacOS Sonoma plus tard cet automne. Selon les notes de version d’Apple, il s’agit de petites corrections de bogues et des optimisations de performances. Plus important pour la plupart des utilisateurs, près de 30 mises à jour de sécurité corrigent plusieurs vulnérabilités couvrant Safari, Raccourcis, FindMy et diverses ressources système et reconnues comme étant à haut risque ; celles-ci pouvant entraîner l’exécution de codes arbitraires, ainsi que des correctifs pour les applications système.

Dans le détail, l’une des vulnérabilités, CVE-2023-32416, découverte par Wojciech Regula de SecuRing au niveau de FindMy permettait à une application de lire des informations de localisation sensibles. Une autre au niveau des Raccourcis (CVE-2023-32442) et découverte par un chercheur anonyme est un problème d’accès qui donne à un raccourci la capacité à modifier les paramètres sensibles de l’application Shortcuts. En outre, la mise à jour corrige une faille dans les puces M1 et M2. Connue sous le nom de CVE-2023-38580 et découverte par Mohamed Ghannam, cette faille donnait à une application la capacité d’exécuter du code arbitraire sur le noyau. Le problème a été résolu en améliorant la gestion de la mémoire. Apple a également publié des mises à jour de MacOS Monterey (12.6.8) et Big Sur (11.7.9) qui corrigent une grande partie des mêmes vulnérabilités. Recommandée à tous les utilisateurs, cette version n’inclut aucune nouvelle fonctionnalité connue, tout étant réservé pour iOS 17.

Prise en charge des Passkey, contrôle de l’affichage RVB, modernisation de l’explorateur de fichiers et du partage de fichiers locaux,… Microsoft fait le plein de changements dans sa dernière version de Windows 11. Celle-ci sera disponible à l’automne.

Microsoft intègre aujourd’hui plusieurs fonctionnalités importantes dans les dernières versions de Windows 11 Insider Beta Channel ( Insider Preview Build 22621.2050 et Build 22631.2050). L’envoi de ces versions aux utilisateurs du canal bêta a toujours été le premier signal officiel indiquant que Microsoft a approuvé les fonctionnalités en vue de leur livraison. La version 631 inclut toutes les fonctionnalités à des fins de test, tandis que l’autre en retient certaines.

Ces fonctions peuvent sembler familières, surtout pour ceux qui ont suivi les déclinaisons expérimentales des canaux Canary ou Dev, où Microsoft ne lance pas toujours les dernières fonctionnalités sur le marché si les tests sont médiocres. La firme n’a pas précisé quand ce lot de changements serait disponible, mais les mentions de 23H2 étant déjà nombreuses, il semble probable qu’elles apparaîtront en septembre ou en octobre. Voici donc un aperçu de ce que Microsoft promet.

Un explorateur de fichiers modernisé

L’éditeur a déjà remanié l’application Explorateur de fichiers en y ajoutant des onglets, une meilleure visibilité du stockage OneDrive disponible et des informations plus approfondies sur les aperçus de fichiers dans la page de prévisualisation. Cette évolution se poursuit, notamment parce que le cadre WinUI offre une personnalisation plus poussée, selon Microsoft.

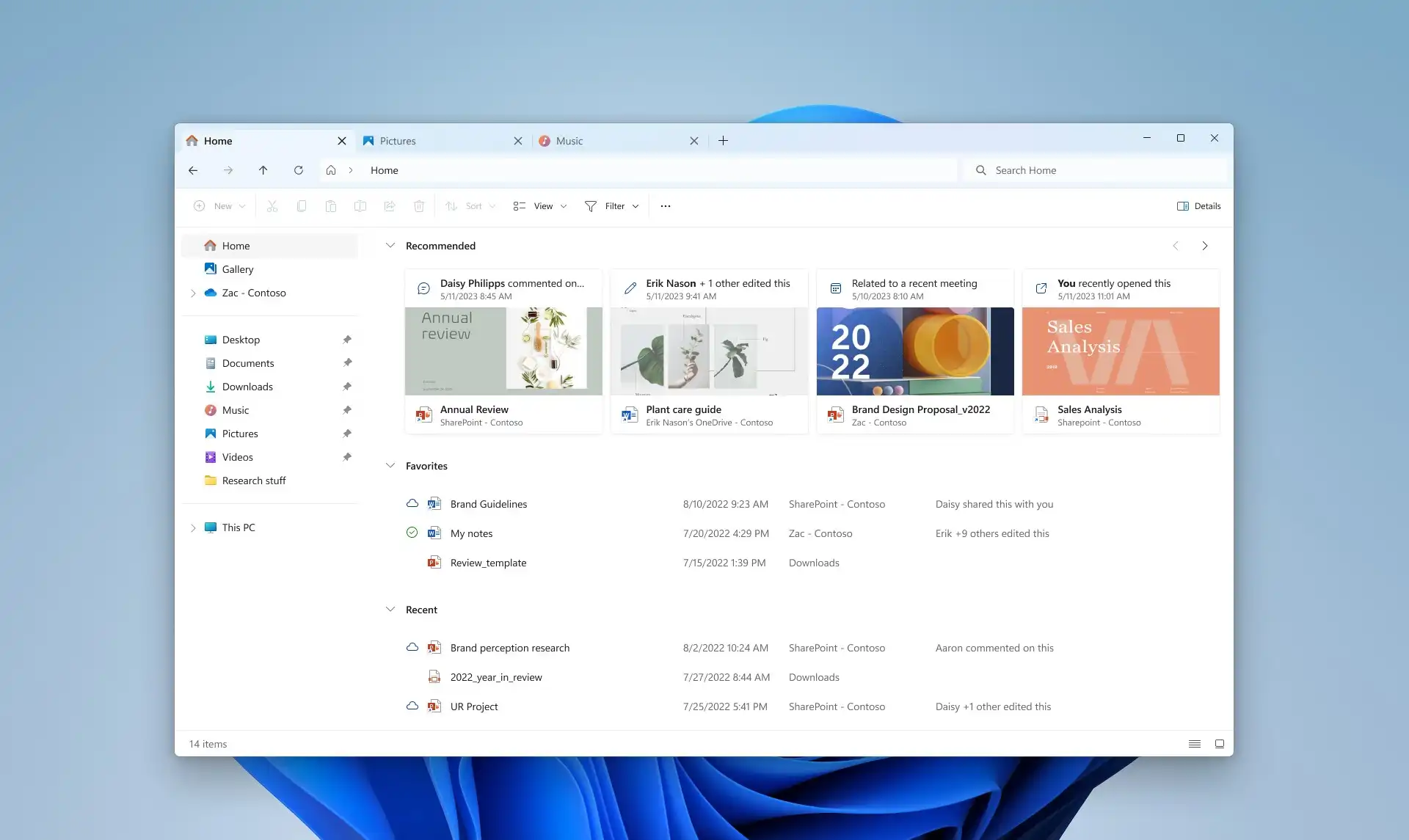

Une vue attrayante du carrousel sera disponible dans la vue d’accueil de l’explorateur de fichiers. (Crédit : Microsoft)

L’Explorateur de fichiers affichera les documents recommandés dans un carrousel à partir de la vue Accueil. De même, le statut OneDrive sera intégré à l’Explorateur de fichiers, et tous les dossiers dans le cloud seront mieux intégrés à Windows. Enfin, le volet Détails de l’explorateur (Alt+Shift+P) affichera même le contenu associé et l’activité récente d’un fichier s’il a été partagé et/ou modifié. Plus précisément, lorsqu’un utilisateur sélectionne un fichier dans l’explorateur de fichiers et active le volet, un volet affichera des informations contextuelles sur le fichier, notamment la vignette du fichier, l’état et le bouton de partage, l’activité du fichier, les fichiers et les courriels associés, ainsi que d’autres informations, a déclaré Microsoft.

Nouveau volet de prévisualisation de l’explorateur de fichiers. (Crédit : Microsoft)

Gestion des clés d’accès

Le mois dernier, Microsoft a commencé à intégrer la prise en charge des clés de sécurité dans son canal de développement Windows Insider. Les passkeys remplacent les mots de passe sur des sites comme BestBuy.com par les données biométriques d’un PC ou d’un téléphone. Si un site Web comme Amazon ajoute la prise en charge des passkeys pour le Web, vous n’aurez plus besoin d’entrer (ou de vous souvenir) de votre mot de passe. Au lieu de cela, vous utiliserez Windows Hello. Microsoft ajoute une page de paramètres (Paramètres > Comptes > Clés d’accès) où il est possible de gérer toutes les clés d’accès aux sites visités. Il s’agit d’une avancée fantastique en termes de facilité d’utilisation, mais il faudra le soutien de l’industrie pour aller plus loin.

Avertissements concernant les mots de passe dangereux

Lors de l’utilisation des mots de passe, Microsoft avertit notamment de ne pas copier votre mot de passe à l’aide de la fonction « couper-coller ». Microsoft ajoute une fonction à Windows Security sous App & browser control > Reputation-based protection > Phishing protection pour avertir l’utilisateur de l’habitude dangereuse de copier un mot de passe par copier-coller.

Windows alerte sur les risques liés à la réutilisation de mots de passe. (Crédit : Microsoft)

L’éclairage dynamique contrôlable

Étant donné que Microsoft a déjà choisi de travailler avec plusieurs fabricants d’accessoires pour PC qui intègrent le RVB, il semblait inévitable que les commandes globales pour l’éclairage RVB des PC, connues sous le nom d’éclairage dynamique, apparaissent dans Windows. Normalement, les fournisseurs proposent souvent leur propre logiciel pour ce contrôle. Des applications tierces tentent également d’offrir un accès général. Microsoft a décidé d’intégrer tout cela dans Windows, afin de rendre le PC aussi lumineux que possible. Une page de configuration de l’éclairage dynamique offrira un guichet unique pour tous ces contrôles.

Les utilisateurs pourront gérer les accessoires RVB depuis Windows avec Dynamic Lighting. (Crédit : Microsoft)

Bien que Microsoft tienne à jour une liste du matériel compatible avec l’éclairage dynamique, au moment de l’impression, cette liste était encore dominée par le matériel Razer.

Les capacités d’écriture du stylet améliorées

Depuis quelques années maintenant, Microsoft a adopté le stylet, à l’instar de ses concurrents. Aujourd’hui, l’encrage fonctionne enfin comme on l’attend. Sous Windows, l’encrage signifiait traditionnellement l’une des deux choses suivantes : dessiner à main levée avec un stylo ou gribouiller du texte à l’intérieur d’une zone dédiée. Auparavant, pour saisir du texte dans un champ particulier, il fallait soit l’encrer (comme une signature), soit l’écrire dans une zone de saisie distincte, où il serait traduit en texte.

Dans le monde réel, vous pouvez écrire sur un morceau de papier tel qu’une autorisation de sortie et notre cerveau l’interprète comme du texte. Désormais, Windows le fait aussi. Si Windows présente un champ de recherche, par exemple, vous pouvez simplement écrire dans le champ de recherche et Windows traduira votre écriture encrée en texte dactylographié et l’entrera dans le champ approprié. Cependant, seul l’anglais est pris en charge.

Voici une mise à jour qui pourrait intéresser les utilisateurs de tablettes Surface Pro (Crédit : Microsoft)

Optimisation de Windows Spotlight

Windows Spotlight est l’une des fonctions très appréciées dans Windows : une simple et magnifique photo du monde naturel qui sert d’arrière-plan pour la journée. La firme améliore encore Spotlight pour offrir plus d’informations sur ce que vous voyez ou même éventuellement planifier un voyage. Pour activer Windows Spotlight sur PC dès aujourd’hui, il suffit de cliquer avec le bouton droit de la souris sur le bureau et choisir Personnaliser, puis sélectionner le dernier thème Spotlight, indique Microsoft. Toutefois, l’entreprise n’a jamais précisé si tous ses arrière-plans étaient formatés pour les écrans 4K, même si l’on note de plus en plus de photographies haute résolution sur écran.

Mise à jour du mixeur de volume

Microsoft a ajouté un mélangeur de volume mis à jour (Win+CTRL+V) qui permet de configurer le volume et la source de l’audio par application, comme il l’avait déjà montré. Microsoft tente également de faciliter l’accès des utilisateurs au son spatial Windows Sonic, en plus des autres technologies d’amélioration du son (Dolby DTS, etc.) qui peuvent être disponibles.

Le mélangeur de volume de Windows 11 profite de la vague d’améliorations. (Crédit : Microsoft)

Un partage de fichiers locaux amélioré

Le partage de fichiers au sein de Windows a toujours été un peu compliqué. Désormais, en cliquant avec le bouton droit de la souris sur un fichier pour le partager, d’autres options s’offrent aux utilisateurs. Cela inclut par exemple un bouton permettant d’activer le partage à proximité. Tout le monde pourra désormais envoyer ses fichiers par courrier électronique via Outlook directement dans la fenêtre de partage de Windows et vous verrez un champ de recherche pour taper les noms des contacts. Windows renverra désormais des suggestions au fur et à mesure que vous le ferez.

Le partage de fichiers entre amis deviendra, espérons-le, plus facile sous Windows 11. (Crédit : Microsoft)

D’autres améliorations mineures arrivent. Windows dispose désormais de voix de narrateur plus naturelles en chinois, espagnol (Espagne et Mexique), japonais et anglais (Royaume-Uni). De leur côté, les notifications urgentes qui sont réglées pour passer outre la fonction « Ne pas déranger » masqueront leur contenu par souci de confidentialité. Par ailleurs, Microsoft ajoute une page de paramètres (Paramètres > Système > Alimentation et batterie > Recommandations énergétiques) pour aider les utilisateurs à économiser de l’énergie en réduisant le taux de rafraîchissement de leur écran.

Elles sont au nombre de sept à s’être engagées auprès du gouvernement américain en matière de développement de l’IA. Si on trouve parmi elles des entreprises comme Amazon, Google, Meta ou encore Microsoft, la raison est simple : ces engagements ne prévoient aucune sanction en cas de non-respect.

Plusieurs des principales entreprises américaines développant l’IA ont accepté de collaborer avec le gouvernement américain et de s’engager à respecter plusieurs principes visant à garantir la confiance du public dans l’IA, a déclaré la Maison Blanche vendredi. Amazon, Anthropic, Google, Inflection, Meta, Microsoft et OpenAI ont tous signé les engagements visant à rendre l’IA sûre, sécurisée et digne de confiance. En mai dernier, déjà, l’administration Biden avait déclaré qu’elle rencontrerait les principaux fournisseurs d’IA pour s’assurer qu’ils étaient en accord avec la politique des États-Unis.

Les garanties ne sont pas contraignantes et aucune sanction n’est prévue en cas de non-respect. Les politiques ne peuvent pas non plus affecter rétroactivement les systèmes d’IA qui ont déjà été déployés – l’une des dispositions stipule que les entreprises s’engagent à tester l’IA pour détecter les failles de sécurité, à la fois en interne et en externe, avant de la mettre sur le marché. Néanmoins, ces promesses visent à rassurer le public (et, dans une certaine mesure, les législateurs) sur le fait que l’IA peut être déployée de manière responsable. L’administration Biden avait déjà proposé d’utiliser l’IA au sein du gouvernement pour rationaliser les tâches.

Un filigrane numérique pour les contenus basés sur l’IA générative

Les effets les plus immédiats se feront peut-être sentir sur la mis en place d’un filigrane numérique (watermark) pour identifier une œuvre comme étant générée par l’IA. Certains services, comme Image Creator de Bing, le font déjà. Cette marque accessible aux lecteurs, auditeurs et spectateurs (pour toucher l’ensemble du spectre des images générées par IA) doit aider à freiner la désinformation qui peut découler de certains de ces contenus. Chacun pourra donc retracer l’origine de tout contenu si besoin.

Tous les signataires ont promis d’utiliser l’IA pour le bien public, comme la recherche sur le cancer, et à identifier les domaines d’utilisation appropriée et inappropriée. Ces domaines n’ont pas été définis, mais ils pourraient inclure les garanties existantes qui empêchent ChatGPT, par exemple, d’aider à planifier un attentat terroriste. Les entreprises spécialisées dans l’IA vont promouvoir la préservation de la confidentialité des données, une priorité que Microsoft a défendue avec les versions professionnelles de Bing Chat et de Microsoft 365 Copilot. Par ailleurs, les acteurs vont tester la sécurité interne et externe de leurs systèmes d’IA avant leur mise en service et à partager des informations avec l’industrie, les gouvernements, le public et les universités sur la gestion des risques liés à l’IA. Enfin, ils assurent l’accès aux chercheurs tiers d’accéder à leurs systèmes pour en découvrir et en signaler les vulnérabilités.

Contenir les risques de dérives de l’IA

Le président de Microsoft, Brad Smith, a approuvé ces engagements, notant que Microsoft a plaidé en faveur de l’établissement d’un registre national des systèmes d’IA à haut risque. (Google a également dévoilé sa propre « red team » de hackers qui tentent de casser l’IA en utilisant des attaques telles que les attaques rapides, l’empoisonnement des données, etc. « Dans le cadre de notre mission de construction d’une IA sûre et bénéfique, nous continuerons à piloter et à affiner des pratiques de gouvernance spécifiquement adaptées à des modèles de fondation comme ceux que nous produisons », a déclaré OpenAI dans un communiqué. « Nous poursuivrons également nos investissements dans la recherche pour adapter la réglementation, tels que les techniques d’évaluation des capacités potentiellement dangereuses dans les modèles d’IA ».

Elles sont au nombre de sept à s’être engagées auprès du gouvernement américain en matière du développement de l’IA. Si on trouve parmi elles des entreprises comme Amazon, Google, Meta ou encore Microsoft, la raison est simple : ces engagements ne prévoient aucune sanction en cas de non-respect.

Plusieurs des principales entreprises américaines développant l’IA ont accepté de collaborer avec le gouvernement américain et de s’engager à respecter plusieurs principes visant à garantir la confiance du public dans l’IA, a déclaré la Maison Blanche vendredi. Amazon, Anthropic, Google, Inflection, Meta, Microsoft et OpenAI ont tous signé les engagements visant à rendre l’IA sûre, sécurisée et digne de confiance. En mai dernier, déjà, l’administration Biden avait déclaré qu’elle rencontrerait les principaux fournisseurs d’IA pour s’assurer qu’ils étaient en accord avec la politique des États-Unis.

Les garanties ne sont pas contraignantes et aucune sanction n’est prévue en cas de non-respect. Les politiques ne peuvent pas non plus affecter rétroactivement les systèmes d’IA qui ont déjà été déployés – l’une des dispositions stipule que les entreprises s’engagent à tester l’IA pour détecter les failles de sécurité, à la fois en interne et en externe, avant de la mettre sur le marché. Néanmoins, ces promesses visent à rassurer le public (et, dans une certaine mesure, les législateurs) sur le fait que l’IA peut être déployée de manière responsable. L’administration Biden avait déjà proposé d’utiliser l’IA au sein du gouvernement pour rationaliser les tâches.

Un filigrane numérique pour les contenus basés sur l’IA générative

Les effets les plus immédiats se feront peut-être sentir sur la mis en place d’un filigrane numérique (watermark) pour identifier une œuvre comme étant générée par l’IA. Certains services, comme Image Creator de Bing, le font déjà. Cette marque accessible aux lecteurs, auditeurs et spectateurs (pour toucher l’ensemble du spectre des images générées par IA) doit aider à freiner la désinformation qui peut découler de certains de ces contenus. Chacun pourra donc retracer l’origine de tout contenu si besoin.

Tous les signataires ont promis d’utiliser l’IA pour le bien public, comme la recherche sur le cancer, et à identifier les domaines d’utilisation appropriée et inappropriée. Ces domaines n’ont pas été définis, mais ils pourraient inclure les garanties existantes qui empêchent ChatGPT, par exemple, d’aider à planifier un attentat terroriste. Les entreprises spécialisées dans l’IA vont promouvoir la préservation de la confidentialité des données, une priorité que Microsoft a défendue avec les versions professionnelles de Bing Chat et de Microsoft 365 Copilot. Par ailleurs, les acteurs vont tester la sécurité interne et externe de leurs systèmes d’IA avant leur mise en service et à partager des informations avec l’industrie, les gouvernements, le public et les universités sur la gestion des risques liés à l’IA. Enfin, ils assurent l’accès aux chercheurs tiers d’accéder à leurs systèmes pour en découvrir et en signaler les vulnérabilités.

Contenir les risques de dérives de l’IA

Le président de Microsoft, Brad Smith, a approuvé ces engagements, notant que Microsoft a plaidé en faveur de l’établissement d’un registre national des systèmes d’IA à haut risque. (Google a également dévoilé sa propre « red team » de hackers qui tentent de casser l’IA en utilisant des attaques telles que les attaques rapides, l’empoisonnement des données, etc. « Dans le cadre de notre mission de construction d’une IA sûre et bénéfique, nous continuerons à piloter et à affiner des pratiques de gouvernance spécifiquement adaptées à des modèles de fondation comme ceux que nous produisons », a déclaré OpenAI dans un communiqué. « Nous poursuivrons également nos investissements dans la recherche pour adapter la réglementation, tels que les techniques d’évaluation des capacités potentiellement dangereuses dans les modèles d’IA ».

Comprendre le fonctionnement de l’esprit humain peut aider à lutter contre les méfaits de l’ingénierie sociale, en renforçant la lutte contre l’hameçonnage et d’autres techniques de manipulation de l’esprit fréquemment utilisées par les cybermalfaiteurs.

En tant qu’expert technologique et chercheur en cybersécurité, Erik J. Huffman connaît bien les astuces des pirates informatiques. Pourtant, il a failli être victime d’une escroquerie après avoir reçu un courriel prétendument envoyé par sa mère pour lui demander une aide financière. Ce courriel lui a immédiatement rappelé tout ce que sa mère avait fait pour sa famille. Il dit avoir entendu sa voix dans son esprit lorsqu’il a lu les mots sur l’écran de l’ordinateur. Bien que M. Huffman sache qu’elle n’avait jamais demandé d’argent auparavant, il s’est empressé de répondre : « De combien as-tu besoin ? »Ce n’est que lorsqu’un autre courriel lui est revenu, lui demandant dans quel délai il pouvait envoyer de l’argent – une autre demande inhabituelle – qu’Erik Huffman s’est interrogé sur l’échange. « Des signaux d’alarme se sont alors allumés », explique-t-il en racontant l’histoire dans son exposé TED intitulé « Human Hacking : La psychologie derrière la cybersécurité ». Dans cet exposé et dans un entretien avec CSO, M. Huffman, fondateur de la société de services de cybersécurité Handshake Leadership, explique pourquoi il a failli tomber dans le piège : il entendait la voix de sa mère dans sa tête lorsqu’il lisait l’e-mail, ce qui donnait l’impression que la demande était réelle. Il voulait se rendre utile. Et, dans la précipitation du quotidien, il n’a pas perçu tout de suite le danger.Les réactions à l’hameçonnage font partie de l’ADN humainErik Huffman n’est pas le seul à avoir ces réactions. Lui et d’autres responsables de la cybersécurité affirment qu’elles sont typiques de l’ADN humain, qui n’a pas encore évolué pour déclencher une réaction de fuite ou d’évasion face à des dangers en ligne. Cette réalité a suscité un intérêt croissant pour la manière dont la science du comportement humain peut informer et améliorer la discipline de la cybersécurité. Un intérêt justifié pour les experts de ce domaine.« Les gens agissent de manière imprévisible, et même s’il est bon d’avoir une authentification multifactorielle et d’autres technologies de sécurité, il suffit qu’une personne réponde à un courriel un jour donné pour mettre l’organisation en danger », explique Lee Hadlington, maître de conférences en cyberpsychologie à la Nottingham Trent University, psychologue agréé et membre du groupe de recherche sur la cyberpsychologie de l’université. « C’est la dimension humaine de la cybersécurité, et c’est un aspect auquel les RSSI doivent commencer à réfléchir davantage. »L’intersection de la cybersécurité et de la psychologieLes psychologues de la cybersécurité et les praticiens en entreprise soulignent tous les deux la nécessité de mieux comprendre comment les êtres humains interagissent avec la technologie afin de renforcer le dispositif de sécurité IT. Ils s’appuient sur des statistiques montrant que la plupart des violations de données sont dues à une erreur humaine. Le rapport 2023 Data Breach Investigations Report de Verizon, par exemple, a révélé que « 74 % de toutes les violations comprennent un élément humain, les personnes étant impliquées soit par erreur, soit par abus de privilèges, soit par l’utilisation d’informations d’identification volées, soit par ingénierie sociale. »Comme le dit Erik Huffman, les pirates informatiques « ne veulent pas s’attaquer à votre pare-feu. Ils ne veulent pas défier votre antivirus, parce que c’est très difficile, pas quand ils peuvent exploiter la plus grande vulnérabilité de tous les réseaux de la planète à l’heure actuelle – c’est-à-dire nous, les humains. Les cybercriminels ne se contentent pas de pirater des ordinateurs, ils piratent des personnes. Parce que, contrairement aux ordinateurs, nous réagissons à la propagande. » La psychologie permet de comprendre pourquoi les êtres humains font ce qu’ils font, pointe Erik Huffman. Pour celui-ci, comme pour M. Hadlington et d’autres chercheurs qui étudient le rôle de la nature humaine dans la cybersécurité, il existe de multiples raisons psychologiques pour lesquelles des employés se laissent séduire par des tentatives d’hameçonnage et d’autres escroqueries de pirates informatiques.Les employés ne perçoivent pas « le danger de l’inconnu »Tout d’abord, de nombreux travailleurs cliquent alors qu’ils ne le devraient pas parce qu’ils sont concentrés sur leur travail. Ils se disent : « J’essaie simplement de faire mon travail. Je veux que mon patron arrête d’être derrière mon dos », explique Lee Hadlington. « Ou bien il s’agit simplement d’un accident : ils ont pensé faire ce qu’il fallait », poursuit-il, ajoutant que la plupart des êtres humains veulent se rendre utiles lorsqu’ils reçoivent une demande au travail. Par ailleurs, les travailleurs n’ont pas été conditionnés à se méfier des inconnus en ligne ; ils ne pensent pas au « danger de l’inconnu » comme ils le feraient dans la vie réelle, explique M. Huffman. Et chacun a encore tendance à penser qu’il ne sera pas escroqué. « Les employés sont dans un déni plausible. Ils pensent que cela ne leur arrivera pas et que moins ils y pensent, moins ils seront une cible », observe Lee Hadlington.Les pirates informatiques comprennent tout cela, explique Stephanie Carruthers, chief people hacker chez IBM. Cette spécialiste du volet humain du piratage explique que les cybermalfaiteurs conçoivent souvent des attaques qui créent un sentiment de peur, d’urgence ou d’autorité pour inciter les gens à réagir. C’est pourquoi un message tel que « Vous perdrez vos avantages sociaux si vous ne remplissez pas ces formulaires aujourd’hui » est efficace, explique Mme Carruthers. Un tel message détourne l’amygdale du lecteur, la partie du cerveau qui détecte les menaces et y répond. « Vous réagissez très vite », dit-elle. « Et lorsque vous avez ces émotions fortes, vous arrêtez de regarder les signaux d’alarme. »Pourquoi intégrer la psychologie dans la sécurité ?L’application de la psychologie à la sécurité IT aide les professionnels de la cybersécurité à comprendre où, comment et pourquoi ils ne parviennent pas à mettre en place un programme de sécurité efficace, affirment les experts. « Nous devons concevoir la sécurité en pensant aux gens, car si la sécurité ne fonctionne pas pour eux, elle ne fonctionne tout simplement pas », explique John Blythe, spécialiste des sciences du comportement et directeur de la psychologie des employés en matière de cybersécurité chez Immersive Labs, créateur d’une plateforme de formation à la cybersécurité. John Blythe cite en exemple les exigences en matière de mots de passe : le fait d’exiger des combinaisons complexes de lettres, de chiffres et de symboles, ainsi que des changements fréquents, surcharge la mémoire des employés, qui finissent par utiliser des mots de passe plus faibles (et par les écrire) afin de pouvoir accéder aux systèmes nécessaires à l’exécution de leur travail. « C’est pourquoi, dit-il, le fait de demander aux travailleurs d’utiliser trois mots aléatoires est plus efficace pour la mémoire humaine » et pour la sécurité. Le Centre national de cybersécurité du Royaume-Uni renforce ce point en indiquant que les mots de passe de trois mots sont « suffisamment longs » et « suffisamment forts » pour la plupart des cas.M. Huffman cite un autre exemple où la science de la psychologie montre que la sécurité peut se retourner contre elle-même. Pour celui-ci, les praticiens de la sécurité qui disent « la question n’est pas de savoir s’il y a une faille, mais quand » (ou une variante de cette formule) peuvent en fait faire plus de mal que de bien. Il explique que cela est lié à l’effet Pygmalion, un phénomène psychologique dans lequel le fait de fixer des attentes élevées conduit à des performances plus élevées, tandis que le fait de fixer des attentes faibles conduit à des résultats faibles. « Lorsque nous disons ‘ce n’est pas si, mais quand’, nous enlevons le contrôle à l’utilisateur », explique Erik Huffman. Il s’interroge : qu’est-ce qui incite les utilisateurs à suivre les meilleures pratiques, en particulier lorsque ces dernières nécessitent des efforts supplémentaires, si on leur dit que cela n’aura pas nécessairement d’importance ? Au lieu de cela, donnez à chaque utilisateur le pouvoir et le contrôle en disant : nous pouvons arrêter ces attaques. Nous pouvons surmonter cela. Nous ne serons pas attaqués parce que nous suivrons les bons processus. »La sécurité psychologique est une sécurité efficaceEn tant que PDG et fondatrice de RevolutionCyber, Juliet Okafor aide les organisations à passer de la sensibilisation à l’adoption de bonnes pratiques en cybersécurité. Elle propose aussi des services de responsable de la sécurité de l’information des entreprises en temps partagé. Juliet Okafor, qui est également avocate et a une formation en communication, se concentre sur la composante humaine de la construction d’une organisation cyberrésiliente. Elle explique qu’elle s’inspire des principes de marketing et de vente qui permettent de convaincre une personne de faire un achat ou d’entreprendre une action. « Il s’agit de convaincre quelqu’un de prendre une décision qu’il ne prendrait pas normalement. La cybersécurité, c’est la même chose. Il s’agit de convaincre les gens que la cybersécurité fait partie de leur travail. Pour ce faire, la cybersécurité doit faire appel à la psychologie. Elle exige de la psychologie pour être efficace », explique Mme Okafor.Telle une professionnelle du marketing, Mme Okafor a élaboré et utilise des personas pour l’aider à affiner les messages de cybersécurité qu’elle délivre aux individus. Ces personas tiennent compte de leurs rôles, de leurs motivations, de la manière dont ils préfèrent apprendre et d’autres facteurs. « Cela nous permet de personnaliser les campagnes, de mieux sensibiliser les gens et de mieux limiter les risques », explique-t-elle.Selon Mme Okafor, les cyberpsychologues utilisent également leur formation pour identifier les vulnérabilités des entreprises. Elle cite des recherches montrant que le comportement plus pressé des gens à certains moments de la journée, par exemple juste avant le déjeuner ou au moment de partir, les rend plus enclins à cliquer sur des courriels contenant des attaques d’hameçonnage. (Les cyberpsychologues appellent ces moments de précipitation un état viscéral « chaud »). Les équipes de sécurité qui comprennent cette dynamique peuvent agir sur la base de cette information, dit-elle, par exemple en ajustant leur plateforme de gestion des informations et des événements de sécurité (SIEM) afin de créer davantage de sas de sécurité pour les courriels à ces moments-là.La cyberpsychologie fonctionne aussi dans la formationJuliet Okafor a également appliqué la psychologie à la formation des équipes de sécurité, après avoir travaillé avec des entreprises cherchant à améliorer leurs délais de réponse aux incidents. Elle a organisé des concours pour former les équipes et a demandé aux gagnants de partager leurs stratégies, en tirant parti, dans le premier cas, de la nature généralement compétitive des spécialistes de la sécurité et, dans le second, de leurs motivations à faire le bien et à être perçus comme des gardiens de confiance. Comme elle l’explique : « Il s’agit de prendre ce que l’on sait sur la façon dont les gens travaillent et de créer des politiques pour s’assurer que les bons contrôles sont en place ».Christie Wilson, responsable de la cyberrésilience chez UniSuper, explique qu’elle aussi intègre la psychologie dans le programme de sécurité de son organisation. Mme Wilson, qui est titulaire d’une licence et d’un diplôme d’études supérieures en sociologie, explique qu’elle s’efforce « d’analyser et de prédire les interactions, les motivations et les vulnérabilités humaines, qui sont des éléments importants pour la protection contre les cybermenaces et la conception de mesures de sécurité efficaces ». Mme Wilson explique que cela l’a aidée à mettre au point une formation de sensibilisation qui suscite un meilleur écho auprès des gens et les aide à mieux comprendre pourquoi ils doivent adhérer au programme de cyberrésilience de l’entreprise.Les êtres humains sont un vecteur d’attaque, pas un maillon faibleCet état d’esprit a même amené Christie Wilson à revoir sa façon de considérer les employés comme le « maillon faible ». « Les employés ne sont pas le maillon faible », souligne-t-elle. « Ils sont le principal vecteur d’attaque. Il est important que nous comprenions cela lorsque nous créons des contenus de sensibilisation et de formation. En tant que professionnels de la sécurité, nous devons nous mettre à la place de nos collaborateurs. La sécurité peut être le sujet le plus important au monde pour nous, mais pour d’autres, cela peut représenter tout autre chose, d’un frein à quelque chose qu’ils n’envisagent jamais ». Elle ajoute : « Comprendre que le changement de comportement nécessite de la motivation, de la capacité et des incitations a été un élément clé de notre programme de cyberrésilience ».Selon John Blythe, le moyen le plus efficace pour les RSSI d’intégrer la psychologie dans leur programme de sécurité est de faire appel à un cyberpsychologue, qui connaît cette science et son fonctionnement. D’autres partagent ce point de vue, mais ils reconnaissent qu’il s’agit là d’une demande importante et difficile à satisfaire. D’une part, peu de personnes sont formées à cette discipline. La cyberpsychologie, qui s’intéresse à la façon dont l’esprit réagit lorsque les gens interagissent avec la technologie, est encore un domaine relativement nouveau, explique Lee Hadlington. En outre, tous les cyberpsychologues et tous les programmes de cyberpsychologie ne se concentrent pas sur la cybersécurité. Les RSSI qui travaillent déjà avec des budgets restreints n’ont peut-être pas les moyens de financer un tel poste.Néanmoins, l’intérêt et l’information sur l’intersection de la psychologie et de la cybersécurité se répandent. Lee Hadlington adopte une approche de « formation des formateurs ». Erik Huffman effectue des recherches et donne des conférences sur le sujet. Par exemple, le SANS Institute, un organisme de formation, organise un sommet sur la gestion des risques humains en août 2023, qui abordera en partie le facteur psychologique.Inclure la psychologie dans le département SSISelon les experts, les RSSI peuvent apprendre à intégrer la psychologie dans leurs programmes de sécurité afin de renforcer l’efficacité de leur travail. Pour commencer, Lee Hadlington et Erik Huffman recommandent tous deux aux CISO de communiquer davantage. Ils devraient demander aux employés où ceux-ci se heurtent aux contrôles de sécurité, pourquoi ils contournent les politiques de sécurité, pourquoi ils ont cliqué sur le lien d’une escroquerie par hameçonnage simulée (ou réelle) ou encore ce qui les motiverait à se soucier davantage de la sécurité. Ils doivent ensuite s’attaquer à ces éléments humains.Les RSSI devraient également donner aux employés les moyens de résoudre leurs problèmes et leur expliquer clairement comment ils font la différence en matière de sécurité. « Cette boucle de rétroaction est vraiment essentielle », explique Lee Hadlington. « Les collaborateurs veulent savoir pourquoi ils font cela. Qu’est-ce que j’y gagne ? Est-ce que j’aide l’organisation ? Ce que je fais est-il efficace ? »En outre, M. Huffman indique que les RSSI peuvent collaborer avec leurs services marketing pour apprendre les techniques permettant d’influencer les comportements. Et, tout comme le marketing personnalise les messages qu’il envoie à son public, Erik Huffman estime que les départements SSI peuvent personnaliser la sensibilisation et la formation à la sécurité.S’attaquer aux problèmes qui créent un « état d’échauffement psychologique »Les RSSI peuvent également collaborer avec leurs collègues de la direction pour résoudre les problèmes culturels qui favorisent les états d’excitation psychologique, explique Erik. Huffman, en soulignant qu’un lieu de travail où les employés sont constamment inquiets ou déraisonnablement occupés « donne un autre avantage aux pirates informatiques ».Lance Spitzner, directeur de la recherche et de la communauté au SANS Institute, conseille aux RSSI d’adopter une vision plus large du sujet, en appliquant la psychologie et les sciences du comportement pour influencer non seulement les travailleurs individuels, mais aussi le comportement organisationnel dans son ensemble. « Il s’agit de créer un environnement dans lequel les humains adoptent des comportements de sécurité forts », explique-t-il. « Pour sécuriser les organisations, nous devons sécuriser les personnes. Et pour sécuriser les personnes, nous devons changer leurs comportements. Et pour changer leurs comportements, nous devons à la fois les motiver et leur donner les moyens de changer. C’est là que les sciences cognitives entrent en jeu ».

Selon l’analyste de Bloomberg Mark Gurman, Apple a développé son propre framework d’IA générative – nom de code « Ajax » – et a même commencé à tester son propre service de chatbot.

Cela fait des années qu’Apple mise sur l’IA qu’elle utilise sur ses terminaux pour améliorer les photos, reconnaître et interpréter la voix, extraire des sujets d’images et bien d’autres choses encore. Mais sur l’IA générative, la firme de Cupertino semble aux abonnés absents. Faux, répond Mark Gurman, analyste pour Bloomberg, Apple aurait développé discrètement son propre framework baptisé Ajax et l’aurait déjà utilisé pour un service de chatbot nommé en interne Apple GPT.

La prudence d’Apple sur cet outil s’explique par la volonté de fournir une solution garante de la confidentialité des données. Reste que la société ne pouvait pas rester en dehors de cette tendance et s’est donc concentrée sur la création de ce framework. Ajax repose sur le framework de machine learning Jax de Google et fonctionne sur Google Cloud, précise Bloomberg. Le chatbot « Apple GPT », quant à lui, aurait été développé en fin 2022 par une très petite équipe d’ingénieur et les tests ont été réalisés sur des collaborateurs autorisés. La société travaille également sur l’élaboration de son propre LLM similaire à GPT-4 d’OpenAI, Llama 2 de Meta ou PaLM 2 de Google.

Un travail plus étroit entre la division IA et logicielle

L’article de Bloomberg souligne que le chatbot reproduit, selon les collaborateurs l’ayant testé, l’expérience de Bard, de ChatGPT et Bing AI, sans ajout supplémentaire. L’Apple GPT dispose d’une interface dépouillée et n’a pour l’instant pas vocation à devenir public. Si ces informations sont exactes, cela signifie que l’organisation d’Apple change. Ainsi, la division IA de la société, dirigée par John Giannandrea, travaille plus étroitement avec la division logicielle de Craig Federighi. On leur prête la volonté de faire une annonce importante en rapport avec l’IA l’an prochain.

Ce rapprochement laisse augurer d’une plus grandes intégration de l’IA générative dans les différents produits et services du fournisseur. Apple est peut-être un peu en retard, mais il semble que l’entreprise prenne la technologie très au sérieux. Et comme le veut la coutume chez Apple, celle-ci fera une entrée remarquée dès qu’elle arrivera.

Selon l’analyste de Bloomberg Mark Gurman, Apple a développé son propre framework d’IA générative – nom de code « Ajax » – et a même commencé à tester son propre service de chatbot.

Cela fait des années qu’Apple mise sur l’IA qu’elle utilise sur ses terminaux pour améliorer les photos, reconnaître et interpréter la voix, extraire des sujets d’images et bien d’autres choses encore. Mais sur l’IA générative, la firme de Cupertino semble aux abonnés absents. Faux, répond Mark Gurman, analyste pour Bloomberg, Apple aurait développé discrètement son propre framework baptisé Ajax et l’aurait déjà utilisé pour un service de chatbot nommé en interne Apple GPT.

La prudence d’Apple sur cet outil s’explique par la volonté de fournir une solution garante de la confidentialité des données. Reste que la société ne pouvait pas rester en dehors de cette tendance et s’est donc concentrée sur la création de ce framework. Ajax repose sur le framework de machine learning Jax de Google et fonctionne sur Google Cloud, précise Bloomberg. Le chatbot « Apple GPT », quant à lui, aurait été développé en fin 2022 par une très petite équipe d’ingénieur et les tests ont été réalisés sur des collaborateurs autorisés. La société travaille également sur l’élaboration de son propre LLM similaire à GPT-4 d’OpenAI, Llama 2 de Meta ou PaLM 2 de Google.

Un travail plus étroit entre la division IA et logicielle

L’article de Bloomberg souligne que le chatbot reproduit, selon les collaborateurs l’ayant testé, l’expérience de Bard, de ChatGPT et Bing AI, sans ajout supplémentaire. L’Apple GPT dispose d’une interface dépouillée et n’a pour l’instant pas vocation à devenir public. Si ces informations sont exactes, cela signifie que l’organisation d’Apple change. Ainsi, la division IA de la société, dirigée par John Giannandrea, travaille plus étroitement avec la division logicielle de Craig Federighi. On leur prête la volonté de faire une annonce importante en rapport avec l’IA l’an prochain.

Ce rapprochement laisse augurer d’une plus grandes intégration de l’IA générative dans les différents produits et services du fournisseur. Apple est peut-être un peu en retard, mais il semble que l’entreprise prenne la technologie très au sérieux. Et comme le veut la coutume chez Apple, celle-ci fera une entrée remarquée dès qu’elle arrivera.

L’intégration de Cisco Secure Firewall ASA, conditionné sous forme de conteneur Docker, au Catalyst 9300, simplifie et sécurise un peu plus la segmentation des ressources réseau.

La solution de pare-feu conteneurisé annoncée par Cisco pour sa vénérable famille de commutateurs Catalyst vise à faciliter la segmentation des ressources réseau pour les clients d’entreprise qui utilisent des systèmes IT/OT mixtes, mais aussi à leur faire économiser de l’argent en consolidant les déploiements réseau et de sécurité. Plus précisément, le conteneur basé sur Docker construit par Cisco pour son Secure Firewall Adaptive Security Appliance (ASA) peut être hébergé sur les commutateurs d’accès Catalyst 9300. Secure Firewall ASA combine pare-feu, antivirus, prévention des intrusions, cryptage et support des réseaux privés virtuels (VPN). Le pare-feu prend en charge jusqu’à 10 interfaces logiques, toutes utilisables pour la segmentation. « Parce qu’elle confine n’importe quelle violation à une zone spécifique, cette segmentation limite la capacité d’un attaquant à se déplacer latéralement au sein du réseau », a écrit Pal Lakatos-Toth, un chef de produit d’ingénierie au sein du groupe de sécurité de Cisco, dans un blog à propos de l’annonce. « L’intégration des technologies de l’information (IT) et des systèmes de technologie opérationnelle (OT), également connue sous le nom de convergence IT/OT, est un processus crucial dans des secteurs comme la fabrication, l’énergie et les services publics. Alors que les systèmes IT s’occupent de la gestion des données, les systèmes OT gèrent les processus physiques et les systèmes de contrôle des infrastructures critiques comme les réseaux électriques, les stations d’épuration et les équipements de fabrication », a encore écrit M. Lakatos-Toth.

La transformation numérique et les initiatives de fabrication intelligente ont accéléré la convergence des réseaux IT et OT, et « même si cette intégration peut apporter des avantages significatifs, notamment une efficacité accrue, une meilleure visibilité et une meilleure prise de décision, elle peut aussi augmenter le risque de cyberattaques », a déclaré Pal Lakatos-Toth. « En hébergeant le Secure Firewall ASA conteneurisé sur des commutateurs d’accès Catalyst 9300, les entreprises peuvent simplifier l’acheminement du trafic vers des pare-feux centralisés à l’aide de tunnels complexes », a expliqué M. Lakatos-Toth. « Les services de pare-feu sont ainsi plus proches de la source, si bien que cette solution est rentable et efficace pour sécuriser les réseaux convergents IT/OT. Elle réduit également la latence pour les applications sensibles au temps en appliquant les politiques près de la source, là où les appareils se connectent au réseau », a encore fait valoir M. Lakatos-Toth.

Déploiement sécurisé sur de grands réseaux

Le Secure Firewall ASA conteneurisé maintient une table de connexion avec état qui garde la trace de l’état et du contexte de chaque connexion réseau qui passe et il applique un contrôle d’accès basé sur le contexte. « Si une application a besoin de ports supplémentaires pour fonctionner, le pare-feu ouvre dynamiquement ces ports et en assure le suivi, tout en veillant au maintien des politiques de sécurité et des contrôles d’accès. Tous ces événements sont enregistrés à des fins d’audit et peuvent être utilisés pour tracer et prévenir les failles de sécurité », a déclaré M. Lakatos-Toth. Pour le contrôle d’accès dans le réseau IT/OT, le Secure Firewall ASA conteneurisé utilise des listes de contrôle d’accès (Access Control Lists, ACL) et des étiquettes de groupe de sécurité (Security Group Tags, SGT). « Avec les SGT, le pare-feu applique des politiques de sécurité basées sur des étiquettes plutôt que sur des adresses IP. Il utilise les SGT pour authentifier les dispositifs OT et les assigner à un groupe de sécurité spécifique, comme ‘OT’, et l’utiliser ensuite pour l’inspection dynamique », a déclaré M. Lakatos-Toth. La solution ASA est gérée via l’Enterprise DNA Center de Cisco (DNAC) afin de prendre en charge la gestion et les configurations de connectivité réseau. Le DNAC garantit que l’application de pare-feu est toujours à jour et sécurisée. « Cisco Defense Orchestrator prend également en charge le système et permet de créer et de déployer des politiques de sécurité cohérentes sur de vastes réseaux. Il effectue l’analyse des politiques et rationalise les processus de configuration et de gestion », a écrit M. Lakatos-Toth.

Si c’est la première fois que Cisco déploie un pare-feu sur le 9300, cela fait plusieurs années que le commutateur inclut la prise en charge des conteneurs Docker. L’idée était de permettre aux clients de créer leurs propres applications pour le commutateur sans avoir à les réécrire à chaque changement d’infrastructure. Selon Cisco, les conteneurs Docker sont légers et utilisent très peu de CPU et de mémoire. « Par exemple, dans une grande entreprise, un opérateur de réseau peut héberger une application de surveillance de réseau sur les plateformes d’accès Cisco Catalyst pour localiser précisément les problèmes dans le réseau et agir en conséquence, grâce aux informations reçues en temps réel », a déclaré Cisco. Le Secure Firewall ASA conteneurisé sera disponible en octobre sur le commutateur Catalyst 9300 avec la version IOS EX 17.12.2.

L’European Policy Center appelle l’UE à développer un programme de cybersécurité lié au quantique, à partager les informations et les meilleures pratiques et à adopter une approche commune.

L’informatique quantique fascine autant qu’elle effraye, notamment dans le domaine de la cybersécurité. L’European Policy Center a rédigé un document appelant l’UE à adopter un plan d’action coordonnée pour se préparer aux cyberattaques basées sur le quantique. Dans le même temps, elle doit assurer une transition harmonisé dans le chiffrement post quantique. Andrea G. Rodríguez, analyste en chef de la politique numérique à l’European Policy Center, explique que « les progrès de l’informatique quantique mettent en danger la cybersécurité de l’Europe en rendant les systèmes de cryptage actuels obsolètes et en créant de nouveaux défis en matière de cybersécurité ».

Selon les experts, ce scénario peut devenir réalité dans les cinq à dix prochaines années, et rendre toutes les data protégées par les protocoles de cryptage actuels, vulnérables aux acteurs malveillants. « Pour que l’Europe prenne au sérieux ses ambitions en matière de cybersécurité, elle doit élaborer un programme de cybersécurité quantique, en partageant les informations et les meilleures pratiques et en adoptant une approche commune de la transition quantique dans tous les États membres », a déclaré la responsable.

Un impact trop largement ignoré par l’UE

« L’informatique quantique perturbera la sécurité en ligne en compromettant la cryptographie ou en facilitant les campagnes malveillantes, notamment celles sur les identités numériques », a écrit l’analyste en chef. Elle ajoute « Les cyberattaques sur le chiffrement menées à partir de systèmes quantiques donnent les moyens aux adversaires de décoder les informations chiffrées, d’interférer avec les communications et d’accéder aux réseaux et aux SI sans autorisation, ouvrant ainsi la porte au vol et au partage d’informations précédemment confidentielles ».

« Les cybercriminels et les adversaires étatiques se précipitent pour obtenir des informations chiffrées, sensibles, illisibles aujourd’hui, mais qui seront décodées une fois que les ordinateurs quantiques seront disponibles. Ces types d’offensive, connues sous le nom de « harvest attacks » ou « download now-decrypt later », qui consistent à collecter des données aujourd’hui pour les déchiffrer demain, constituent déjà un risque pour la sécurité européenne. « L’impact de l’informatique quantique sur la cybersécurité et la protection des données en Europe a été largement ignoré, malgré des mentions sporadiques dans certains documents politiques comme le rapport ‘2020 EU Cybersecurity Strategy’, ou le ‘2022 Union Secure Connectivity Program’ », souligne Andrea G. Rodríguez.

Les États-Unis, déjà engagés dans une cybersécurité post-quantique

Selon l’analyste, les États-Unis sont sans doute à la pointe de la transition vers la cybersécurité post-quantique, et en particulier dans la cryptographie post-quantique qui sera appelée à jouer un rôle central. « Le National Institute of Standards and Technology (NIST) a lancé un processus de normalisation des algorithmes de cryptographie post-quantique, tandis que le Quantum Cybersecurity Preparedness Act, créé en 2022, établit une feuille de route pour faire migrer les informations gouvernementales vers la cryptographie post-quantique », glisse-t-elle. « En 2023, la US National Cybersecurity Strategy a fait de la protection contre les cyberattaques quantiques un objectif stratégique. Cette priorité englobe l’utilisation du chiffrement post-quantique et la nécessité de remplacer le matériel, les logiciels et les applications vulnérables qui pourraient être compromis », a-t-elle ajouté.

La cybersécurité post-quantique de l’UE, trop limitée

« Dans le même temps, les efforts de l’UE pour sécuriser les informations contre les cyberattaques quantiques manquent d’une stratégie claire sur la manière de traiter les menaces à court terme », a encore déclaré l’analyste de l’European Policy Center. « Le peu de focalisation de l’UE sur l’atténuation des défis de cybersécurité quantique à court terme, en particulier les attaques de récolte dites « harvest attacks », et les attaques quantiques sur le cryptage, laisse les États membres en première ligne dans la transition quantique », ajoute-t-elle. « D’ici à 2023, seuls quelques pays de l’UE auront élaboré des plans publics pour contrer les menaces émergentes en matière de cybersécurité quantique, et un nombre encore moins important aura mis en place des stratégies pour les atténuer, comme c’est le cas de l’Allemagne ».

À mesure que les systèmes quantiques se développent, une action européenne sera nécessaire pour prévenir les failles de cybersécurité exploitables comme vecteurs d’attaque et pour veiller à ce que tous les États membres soient également résilients face aux cyberattaques quantiques. « Il est urgent de mettre en place un plan d’action coordonné sur la transition quantique avec des objectifs et des calendriers clairs et de surveiller la mise en œuvre des plans nationaux de migration vers le chiffrement post-quantique », a affirmé Andrea G. Rodríguez. Un tel plan comblera le fossé entre l’objectif lointain d’établir un réseau d’infrastructure européenne de communication quantiqu, European Quantum Communication Infrastructure (EuroQCI) pleinement opérationnel et les besoins actuels du paysage européen de la cybersécurité pour répondre aux menaces de cybersécurité quantique à court terme. « L’Europe peut aussi tirer parti de l’expertise des agences nationales de cybersécurité, des experts et du secteur privé en établissant un nouveau groupe d’experts au sein de l’ENISA où les spécialistes nationaux détachés en matière de chiffrement post-quantique peuvent échanger des bonnes pratiques et encourager la mise en place de plans de migration », indique l’analyste.

Un programme de cybersécurité quantique en 6 étapes

Le document de Mme Rodríguez présente six recommandations pour le programme de cybersécurité quantique de l’UE.

– Établir un plan d’action coordonné de l’UE sur la transition quantique qui définisse des objectifs et des calendriers clairs et surveille la mise en œuvre des plans nationaux de migration vers le chiffrement post-quantique.

– Créer un nouveau groupe d’experts au sein de l’ENISA avec des experts nationaux détachés pour échanger les bonnes pratiques et identifier les obstacles à la transition vers le chiffrement post-quantique.

– Aider à fixer des priorités pour la transition vers le chiffrement post-quantique et encourager l’agilité cryptographique pour répondre aux vulnérabilités émergentes dans les systèmes de chiffrement post-quantique.

– Faciliter la coordination politique entre la Commission européenne, les États membres de l’UE, les agences nationales de cybersécurité et l’ENISA afin de déterminer les priorités technologiques et d’identifier les cas d’usage pertinents pour les technologies à sécurité quantique.

– Faciliter la coordination technique au niveau de l’UE pour combler les lacunes de la recherche dans les technologies à sécurité quantique, par exemple développer des nœuds quantiques pour assurer des connexions longue distance pour la distribution de clés quantiques.

– Étudier l’utilisation de bacs à sable pour accélérer le développement d’applications à court terme des technologies de l’information quantique.

La startup israélienne Orca porte plainte contre Wiz. Elle accuse l’entreprise concurrente de piller ses « inventions révolutionnaires » et de créer un clone de sa plateforme de sécurité du cloud.

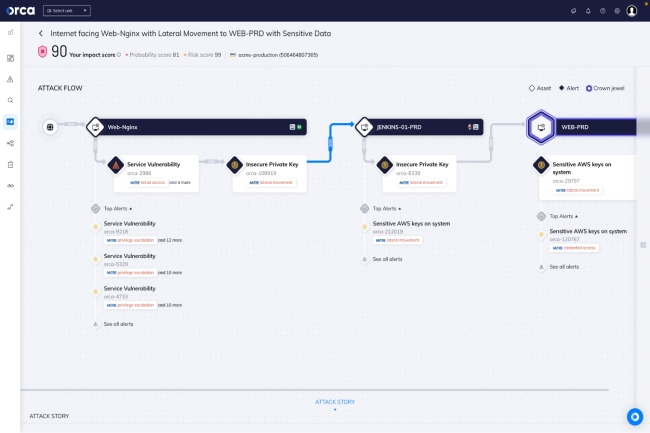

Bisbilles juridiques entre Orca Security, startup israélienne de cybersécurité, qui poursuit son rival pour violation de brevet. Le succès et la croissance de Wiz reposent sur « une copie grossière » de sa propre plateforme, estime le requérant. Dans une plainte déposée auprès du tribunal du district du Delaware, Orca accuse Wiz de piller ses « inventions révolutionnaires » et affirme que le « clone de sa plateforme de sécurité cloud » exploite indûment ses créations. « Cette copie est omniprésente dans l’activité de Wiz et elle s’est manifestée d’une myriade de façons », ajoute dans ses récriminations l’entreprise fondée en 2019 par Avi Shua.

Au cours des quatre années qui ont suivi sa création, Orca a levé d’importants fonds et la société est passée de moins d’une douzaine d’employés à plus de 400 aujourd’hui. Quant à Wiz, l’entreprise concurrente a été fondée en janvier 2020, un an après Orca, par Assaf Rappaport, Ami Luttwak, Yinon Costica et Roy Reznikthat, une équipe qui dirigeait auparavant le Cloud Security Group chez Microsoft. En 2023, Wiz était évaluée à 10 milliards de dollars après avoir levé 300 millions de dollars lors de son dernier tour de table privé au début de l’année.

Wiz, contrefaçon d’Orca ?

La plateforme Wiz a été créée pour « permettre aux équipes de scanner leurs environnements de serveurs et les services cloud pour y détecter les vulnérabilités, les problèmes de configuration, de réseau et d’identité», c’est-à-dire pour faire « exactement ce qu’Orca faisait depuis plus d’un an déjà » indique encore la plainte. « Dès le départ, le projet Wiz contrefait les idées d’Orca », poursuit le document.

« Dans ses produits et services, Wiz a intégré un certain nombre d’inventions révolutionnaires développées et brevetées par Orca, qu’elle a fait passer pour ses innovations et a forcé Orca à concurrencer ses propres avancées technologiques sur le marché. La conduite de Wiz à cet égard est illégale, injuste et en violation des lois américaines sur les brevets », affirme encore l’accusateur.

« Une copie visible sur l’ensemble des activités de Wiz »

Selon la réclamation, le copiage ne se limite pas à la technologie, mais s’étend à l’ensemble des activités du concurrent. « Dans son marketing, Wiz copie le visuel d’Orca, son message et même le café qu’elle utilise lors des salons professionnels », peut-on lire dans la doléance. « Le réplicat grossier de la technologie d’Orca par Wiz a été relevée par des analystes réalisées par des tiers. Par exemple, dans sa comparaison des deux solutions, Sourceforge parle de « caractéristiques de sécurité dans le cloud » identiques pour chaque plateforme. Orca a même accusé son rival d’avoir recruté l’ancien conseiller en brevets d’Orca pour plagier sa propriété intellectuelle.

Ce dernier demande des dommages-intérêts relatifs à ces prétendues violations de brevets qu’elle estime « intentionnelles et délibérées » et dont Wiz a tiré profit. Il exige également que son concurrent cesse de commercialiser et de vendre les produits et services qui, selon lui, ont été imités. Commentant la plainte, Wiz nie ces allégations, qu’elle qualifie d’« accusations sans fondement ». Un porte-parole affirme aussi qu’Orca a essayé de concurrencer Wiz sur plusieurs fronts et qu’il a échoué. « Aujourd’hui, ils utilisent des méthodes moins innovantes. L’action en justice d’Orca fait suite à une autre affaire récente, toujours en cours. En mars 2022, Webroot, l’éditeur de solutions de protection des points de terminaison, a déposé une plainte pour violation de brevet contre son concurrent Trend Micro, l’accusant de mettre en œuvre sans autorisation une technologie brevetée dans ses logiciels et systèmes de sécurité.